[RL][Review] Offline Reinforcement Learning From Algorithms to Practical Challenges

[RL][Review] Offline Reinforcement Learning From Algorithms to Practical Challenges

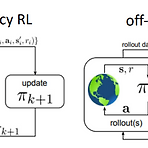

(본문의 의도를 가져오되, 개인적인 의견이 담길 수도 있습니다.) Offline Reinforcement Learning from Algorithms to Practical Challenges - Kumar et al, NeurIPS 2020 Tutorial (사이트, 실습코드) 원래 거진 3시간짜리 tutorial이기 때문에 정리하는데 시간이 걸릴듯 하다. 그래도 전반적인 Offline RL의 문제와 이론에 대해서 잘 설명되어 있어서 차근차근 설명해보고자 한다. 기본적인 RL 내용도 포함되어 있어, Offline RL 부분만 뽑아서 정리한다. Can we develop data-driven RL methods? 보통 강화학습이라고 하면 다음과 같은 환경을 가정하고 진행한다. 일반적으로는 어떤 환경이 주..

[Book] 파이썬을 활용한 금융 분석

[Book] 파이썬을 활용한 금융 분석

(해당 포스트에서 소개하고 있는 "파이썬을 활용한 금융 분석" 책은 한빛 미디어로부터 제공받았음을 알려드립니다.) 파이썬을 활용한 금융 분석(2판) 금융 분야 종사자, 관련 개발자들이 파이썬을 시작하고 이를 활용하여 중용한 금융 분석 업무를 할 수 있도록 도와주는 최적의 실무 가이드 북입니다. hanbit.co.kr 아마 주식을 하고 있다면 솔깃한 내용 중 하나는 과연 인공지능으로 주식을 자동으로 거래하게 해서 돈을 벌 수 있을까 일 것이다. 그래서 시중에도 증권API를 파이썬으로 다루는 방법에 대한 내용을 소개한 책들이 다수 소개되어 있다. 물론 수많은 접근 방식이 있겠지만, 모든 접근 방식보다도 선행되어야 할 것은 데이터 분석이 아닐까 생각된다. (과거를 포함하여) 현재 쌓여 있는 특정 데이터속에서 ..

[RL][Review] Offline RL without Off-Policy Evaluation (onestep-rl)

[RL][Review] Offline RL without Off-Policy Evaluation (onestep-rl)

(논문의 의도를 가져오되, 개인적인 의견이 담길 수도 있습니다.) Offline RL without Off-Policy Evaluation - Brandfonbrener et al, NeurIPS 2021 (논문, 코드) 요약 이전에 수행된 대부분의 Offline RL에서는 off-policy evaluation과 관련된 반복적인 Actor-critic 기법을 활용했다. 이 논문에서는 behavior policy의 on-policy Q estimate를 사용해서 제한된/정규화된 policy improvement를 단순히 한번만 수행해도 잘 동작하는 것을 확인했다.이 one-step baseline이 이전에 발표되었던 논문에 비하면 눈에 띌만큼 간단하면서도 hyperparameter에 대해서 robust한..

[RL][Review] Stabilizing Off-Policy Q-Learning via Bootstrapping Error Reduction (BEAR)

[RL][Review] Stabilizing Off-Policy Q-Learning via Bootstrapping Error Reduction (BEAR)

(논문의 의도를 가져오되, 개인적인 의견이 담길 수도 있습니다.) Stabilizing Off-Policy Q-Learning via Bootstrapping Error Reduction - Kumar et al, NeurIPS 2019 (논문, 코드) 요약 Off-policy RL은 샘플링 관점에서 효율적인 학습을 위해서 다른 policy (behavior policy)로부터 수집한 데이터로부터 경험을 배우는데 초점을 맞추지만, Q-learning이나 Actor-Critic 기반의 off-policy Approximate dynamic programming 기법은 학습시 사용된 데이터와 실제 데이터간의 분포가 다른 문제로 인해서 on-policy data를 추가로 활용하지 않고서는 성능을 개선하기가 어..

[RL][Review] Off-Policy Deep Reinforcement Learning without Exploration (BCQ)

[RL][Review] Off-Policy Deep Reinforcement Learning without Exploration (BCQ)

(논문의 의도를 가져오되, 개인적인 의견이 담길 수도 있습니다.) Off-Policy Deep Reinforcement Learning without Exploration - Fujimoto et al, ICML 2019 (논문, 코드) 요약 이 논문에서는 이미 모아져있는 고정된 dataset 상에서 강화학습 에이전트를 학습할 수 있는 알고리즘을 소개한다. 보통 강화학습은 exploration을 통해서 insight를 얻어내고, 이에 대한 경험으로 성능을 추출하는 형태로 되어 있지만, 고정된 dataset으로부터 학습하게 되면 exploration을 할 수 없기 때문에 성능을 얻어낼 요소가 부족하다. 이런 종류의 알고리즘을 Offline RL 혹은 Batch RL이라고 표현하고, 사실 이 알고리즘은 be..

[Book] 딥러닝 파이토치 교과서

[Book] 딥러닝 파이토치 교과서

(해당 포스트에서 소개하고 있는 "딥러닝 파이토치 교과서" 책은 길벗 미디어로부터 제공받았음을 알려드립니다.) 딥러닝 파이토치 교과서 기초부터 CNN, RNN, 시계열 분석, 성능 최적화, 자연어 처리, 강화 학습, 생성 모델까지! www.gilbut.co.kr 어느 순간부터인가 논문에 구현되어 있는 모델을 github에서 찾다보면 거의 대부분이 pytorch로 구현되어 있다. 현재 현업에서 사용하고 있는 것이 tensorflow다 보니, tensorflow로는 어떻게 구현되어 있나 찾아봐도 진짜 거의 대부분이 pytorch로 되어 있다. 이런 트렌드가 계속 나타나고 있는 이유는 아마 pytorch가 그만큼 대중화되어 사용하기 직관적으로 되어 있어서가 아닐까 싶다. (사실 tensorflow도 2.x대로..

- Total

- Today

- Yesterday

- SketchFlow

- PowerPoint

- arduino

- processing

- 강화학습

- reward

- Expression Blend 4

- Kinect

- End-To-End

- Off-policy

- Offline RL

- 파이썬

- Kinect SDK

- RL

- Windows Phone 7

- Variance

- Policy Gradient

- DepthStream

- windows 8

- 딥러닝

- Python

- Distribution

- ColorStream

- Pipeline

- Gan

- dynamic programming

- 한빛미디어

- TensorFlow Lite

- Kinect for windows

- bias

| 일 | 월 | 화 | 수 | 목 | 금 | 토 |

|---|---|---|---|---|---|---|

| 1 | 2 | |||||

| 3 | 4 | 5 | 6 | 7 | 8 | 9 |

| 10 | 11 | 12 | 13 | 14 | 15 | 16 |

| 17 | 18 | 19 | 20 | 21 | 22 | 23 |

| 24 | 25 | 26 | 27 | 28 | 29 | 30 |